Des familles endeuillées ont exprimé leur horreur face à une tendance macabre sur TikTok, utilisant l’intelligence artificielle pour créer des vidéos d’enfants victimes de meurtres.

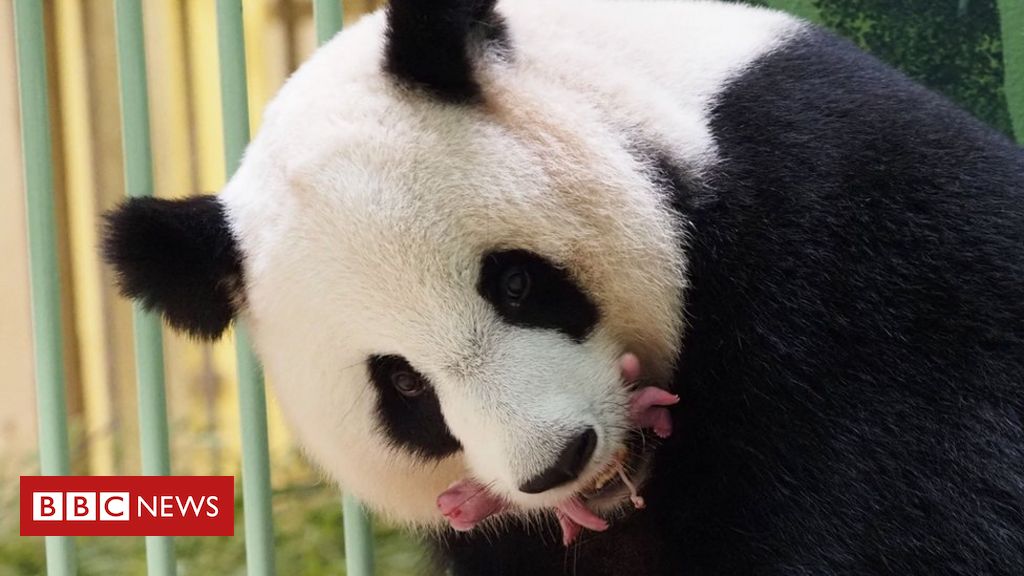

Les vidéos – tournées sans le consentement de leurs familles – montrent des versions grossièrement animées d’enfants, y compris de bébés, racontant comment ils ont été assassinés.

Beaucoup de ces vidéos générées par ordinateur ont été publiées sur TikTok depuis avril, même si la société a annoncé en mars l’interdiction des versions IA pour les mineurs.

Cependant, une enquête de la BBC a révélé qu’il pourrait y avoir une confusion parmi les employés de TikTok concernant les politiques de la plateforme.

Un modérateur du contenu de TikTok a déclaré à la BBC que la société ne lui avait toujours pas informé du changement de règle quatre mois après l’interdiction.

Certaines vidéos des victimes sont restées plusieurs mois sur la plateforme, d’autres ont été visionnées des millions de fois.

Des proches de différents pays ont parlé des versions IA de leurs proches décédés apparaissant en ligne.

La baronne Beeban Kidron, membre indépendante de la Chambre des Lords du Parlement britannique, affirme que les vidéos pourraient être particulièrement pénibles pour les familles endeuillées, car elles présentent des simulations de leurs proches décédés racontant leurs propres histoires.

« Si vous êtes quelqu’un qui était attaché à cet enfant, en particulier un parent ou un proche, c’est une attaque, une attaque émotionnelle », a-t-elle déclaré.

« L’agression la plus grave » Peu de temps après, ces vidéos sont devenues virales et les proches de certains des enfants morts ont commencé à s’exprimer. L’une des premières était une Canadienne nommée Amélie Lemieux.

En juillet 2020, ses filles – Romy, 6 ans, et Norah, 11 ans – ont été assassinées par son ex-mari, qui s’est ensuite suicidé.

En avril de cette année, Lemieux a été choqué de recevoir un TikTok présentant une version alimentée par l’IA de Norah parlant des meurtres.

« C’est la pire agression qu’on puisse imaginer », a déclaré Lemieux.

« Je n’ai pas pu regarder jusqu’au bout, et mon frère non plus. Il m’a crié d’arrêter.

Amélie Lemieux craignait particulièrement que ses nièces et neveux tombent par hasard sur la vidéo de son défunt cousin en parcourant TikTok.

Même si de nombreuses personnes ont signalé la vidéo à l’application, elle est restée en ligne. Finalement, après que Lemieux ait donné une série d’interviews racontant à quel point elle était perturbée par la vidéo, le compte anonyme qui avait publié la vidéo a été supprimé.

Amélie Lemieux n’a pas pu découvrir qui a réalisé la vidéo, mais elle est choquée par les agissements.

« C’est incroyablement choquant pour quelqu’un d’utiliser quelque chose d’aussi dérangeant, quelque chose qui nous laissera incomplets pour le reste de notre vie », a-t-elle déclaré.

« Tout ce qu’ils veulent, ce sont des vues, des likes et des partages. Et des gens qui laissent des commentaires. Personnellement, je ne peux pas pardonner ça. »

Nouvelle technologie La réalisation de ces vidéos a été rendue possible grâce à l’accessibilité croissante en ligne des logiciels d’IA.

Vous pouvez désormais facilement créer et animer une figure humaine de base et fournir un script avec les lignes, qui seront jouées avec une voix générée par ordinateur.

Certains visages dans les vidéos des victimes ne ressemblent pas à la vraie personne. Mais d’autres sont basés sur de vraies photos.

Les personnes qui réalisent ces vidéos essaient généralement de rester anonymes. Mais la BBC a identifié Ritul comme étant un étudiant à Londres.

Sur sa chaîne YouTube, il fait la promotion de vidéos de « storytelling » comme moyen de gagner rapidement des abonnés sur TikTok.

« J’ai gagné des milliers et des milliers de followers en publiant des vidéos qui racontent des histoires, simplement en utilisant l’IA », a-t-il déclaré dans une vidéo. « J’ai eu 47 000 abonnés, et c’était en moins de trois semaines. »

La BBC a contacté Ritul, mais il a refusé de commenter. Votre compte TikTok a été supprimé.

Les vidéos TikTok doivent attirer l’attention en quelques secondes, sinon les utilisateurs continueront à faire défiler. C’est pourquoi des créateurs comme Ritul se sont concentrés sur la création de vidéos sur les cas les plus extrêmes ou les plus médiatisés.

Certaines histoires pour enfants ont fait l’objet de plusieurs vidéos dans différentes langues, dont le portugais, l’espagnol, le français, l’allemand, l’italien et le polonais.

Sur une période de deux mois, la BBC a découvert 170 vidéos TikTok différentes présentant des versions IA de James Bulger, le garçon britannique de deux ans assassiné en 1993 dans le Merseyside, en Angleterre, par deux enfants plus âgés.

Réponse à TikTok Le phénomène a fait la une des journaux britanniques en juillet lorsque la mère de James, Denise Fergus, a déclaré à un journal que les vidéos de son fils étaient « plus que nauséabondes ».

TikTok a procédé à un retrait massif des vidéos et a publié une déclaration disant : « Il n’y a pas de place sur notre plateforme pour un contenu dérangeant de cette nature. Nous continuerons à supprimer ce contenu dès que nous le rencontrerons. »

Parmi les vidéos supprimées de James figuraient deux vidéos en vietnamien qui ont totalisé quatre millions de vues.

La BBC s’est entretenue avec un modérateur de contenu TikTok au Vietnam, qui a accepté d’être interviewé sous couvert d’anonymat.

Il a déclaré que deux semaines après la suppression des vidéos, la société n’avait toujours pas officiellement annoncé que ce type de contenu était interdit.

Il a déclaré à la BBC qu’il pensait que les vidéos avaient été diffusées conformément aux règles de TikTok, qui permettent aux survivants d’abus de partager leurs histoires.

Les employés de TikTok ne sont donc pas clairement informés des politiques réelles de l’entreprise ? TikTok n’a pas spécifiquement commenté ce point lorsque nous avons contacté l’entreprise pour obtenir ses commentaires.

Mais il a précisé que le modérateur avait tort de suggérer que ces vidéos pourraient être autorisées sur la plateforme en tant qu’expériences de survivants – car il s’agit d’images générées par ordinateur d’enfants morts, plutôt que d’expériences réelles de survivants.

Vous pouvez toujours retrouver facilement ce genre de vidéo dans l’application. Mais TikTok affirme avoir toujours été très ouvert sur le fait qu’il ne pouvait pas surveiller tout le contenu disponible.

Couverture supplémentaire par Thuong Le de BBC News Vietnam

« Maven du bacon indépendant. Étudiant. Fan extrême de la culture pop. Joueur amateur. Organisateur. Praticien de Twitter. »

:strip_icc()/i.s3.glbimg.com/v1/AUTH_59edd422c0c84a879bd37670ae4f538a/internal_photos/bs/2023/W/x/oKS14iQqeZXlxUv5AweA/os-videos-de-ia-geralmente-nao-se-parecem-em-nada-com-a-pessoa-real-tiktok.jpg)

:strip_icc()/s04.video.glbimg.com/x720/12563435.jpg)

:strip_icc()/i.s3.glbimg.com/v1/AUTH_59edd422c0c84a879bd37670ae4f538a/internal_photos/bs/2024/B/X/Axv7LEQ7GYpRh2rawOzQ/irrigacao-saulo-coelho-nunes-embrapa.jpg)